في السنوات الأخيرة، شهد مجال الذكاء الاصطناعي تطورًا هائلًا، حيث أصبحت أنظمة الذكاء الاصطناعي قادرة على أداء مهام كانت في السابق حصرية للبشر. ومع ذلك، فإن هذا التطور السريع قد أثار مخاوف بشأن إمكانية استخدام الذكاء الاصطناعي لأغراض ضارة.

مخاطر الذكاء الاصطناعي

يمكن أن يتسبب الذكاء الاصطناعي في ضرر للبشر بعدة طرق، منها:

• القتل أو الإصابة: يمكن استخدام أنظمة الذكاء الاصطناعي لإنشاء أسلحة ذاتية التشغيل، والتي يمكن أن تقتل أو تصيب البشر دون تدخل بشري.

• التحيز: يمكن أن تكون أنظمة الذكاء الاصطناعي متحيزة، مما قد يؤدي إلى التمييز ضد مجموعات معينة من الناس. على سبيل المثال، يمكن أن تؤدي أنظمة الذكاء الاصطناعي المستخدمة لاتخاذ قرارات التوظيف إلى التمييز ضد الأقليات العرقية أو الدينية.

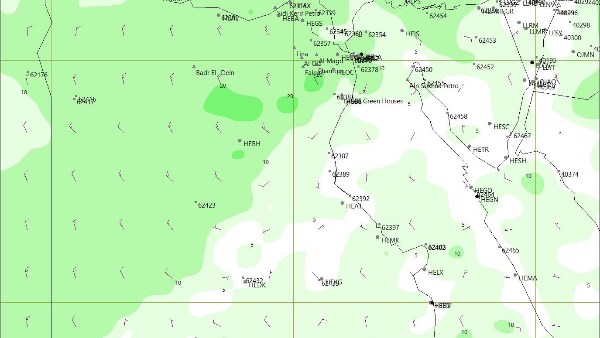

• السيطرة: يمكن استخدام أنظمة الذكاء الاصطناعي لمراقبة الناس أو السيطرة عليهم. على سبيل المثال، يمكن استخدام أنظمة الذكاء الاصطناعي لمراقبة الأشخاص في الأماكن العامة أو لمراقبة ما يفعلونه على الإنترنت.

مخاطر محددة

هناك العديد من المخاطر المحددة التي يمكن أن يتسبب فيها الذكاء الاصطناعي، منها:

• الأسلحة ذاتية التشغيل: يمكن استخدام أنظمة الذكاء الاصطناعي لإنشاء أسلحة ذاتية التشغيل، والتي يمكن أن تقتل أو تصيب البشر دون تدخل بشري. يمكن أن تكون هذه الأسلحة خطيرة للغاية، حيث يمكن استخدامها لشن هجمات دون الحاجة إلى مشاركة بشرية.

• القيادة الذاتية: يمكن استخدام أنظمة الذكاء الاصطناعي للقيادة الآلية، والتي يمكن أن تقلل من عدد الحوادث المرورية. ومع ذلك، هناك أيضًا مخاوف من أن يمكن استخدام أنظمة القيادة الذاتية لأغراض ضارة، مثل مهاجمة الناس أو السيارات الأخرى.

• التعرف على الوجه: يمكن استخدام أنظمة التعرف على الوجه لمراقبة الناس أو تتبعهم. يمكن أن تكون هذه الأنظمة خطيرة للغاية، حيث يمكن استخدامها لاضطهاد المعارضين السياسيين أو الأشخاص الذين ينتمون إلى مجموعات معينة.

الحلول

هناك العديد من الحلول التي يمكن اتخاذها لتقليل مخاطر الذكاء الاصطناعي، منها:

• تطوير معايير أخلاقية للذكاء الاصطناعي: من المهم تطوير معايير أخلاقية للذكاء الاصطناعي لضمان استخدامها بطريقة مسؤولة. يجب أن تتضمن هذه المعايير مبادئ مثل عدم الإضرار بالبشر وعدم التمييز ضد أي مجموعة من الناس.

• زيادة الشفافية حول استخدام الذكاء الاصطناعي: من المهم زيادة الشفافية حول استخدام الذكاء الاصطناعي. يجب أن يكون الناس على دراية بالكيفية التي يتم بها استخدام الذكاء الاصطناعي، حتى يتمكنوا من الإشراف عليه واتخاذ الإجراءات عند الحاجة.

• الاستثمار في البحث والتطوير في مجال الذكاء الاصطناعي: من المهم الاستثمار في البحث والتطوير في مجال الذكاء الاصطناعي. يمكن أن يساعد ذلك في تطوير أنظمة ذكاء اصطناعي أكثر أمانًا وأخلاقية.

يمثل الذكاء الاصطناعي أداة قوية يمكن استخدامها للخير أو الشر. من المهم أن نكون على دراية بالمخاطر المحتملة للذكاء الاصطناعي وأن نتخذ الخطوات اللازمة لتقليل هذه المخاطر.