كشفت دراسة حديثة أن روبوتات الدردشة المدعومة بـ الذكاء الاصطناعي تقدم نصائح طبية غير موثوقة في نحو نصف الحالات، ما يثير مخاوف متزايدة بشأن مخاطر استخدامها في المجال الصحي، في ظل انتشارها المتسارع في الحياة اليومية.

وأجرى باحثون من الولايات المتحدة وكندا والمملكة المتحدة تقييما لخمسة منصات ذكاء اصطناعي بارزة هي ChatGPT وGemini وMeta AI وGrok وDeepSeek، وذلك عبر طرح 10 أسئلة على كل منصة ضمن 5 فئات صحية مختلفة.

وأظهرت النتائج، أن نحو 50% من الإجابات كانت إشكالية، بينها قرابة 20% وصفت بأنها شديدة الخطورة.

وبينت الدراسة أن أداء هذه الأنظمة كان أفضل نسبيا في الأسئلة المغلقة، خصوصا المتعلقة باللقاحات والسرطان، بينما تراجع أداؤها في الأسئلة المفتوحة وموضوعات مثل الخلايا الجذعية والتغذية.

وأشار الباحثون إلى أن الإجابات غالبا ما تقدم بثقة عالية، رغم افتقارها في كثير من الأحيان إلى الدقة أو المراجع الكاملة، إذ لم يتمكن أي نظام من تقديم قائمة مصادر مكتملة وصحيحة، كما سجل حالتا امتناع فقط عن الإجابة، وكانتا من Meta AI.

وتسلط هذه النتائج الضوء على القلق المتزايد من اعتماد المستخدمين على تقنيات الذكاء الاصطناعي التوليدي، التي لا تمتلك ترخيصا لتقديم استشارات طبية ولا القدرة السريرية على التشخيص.

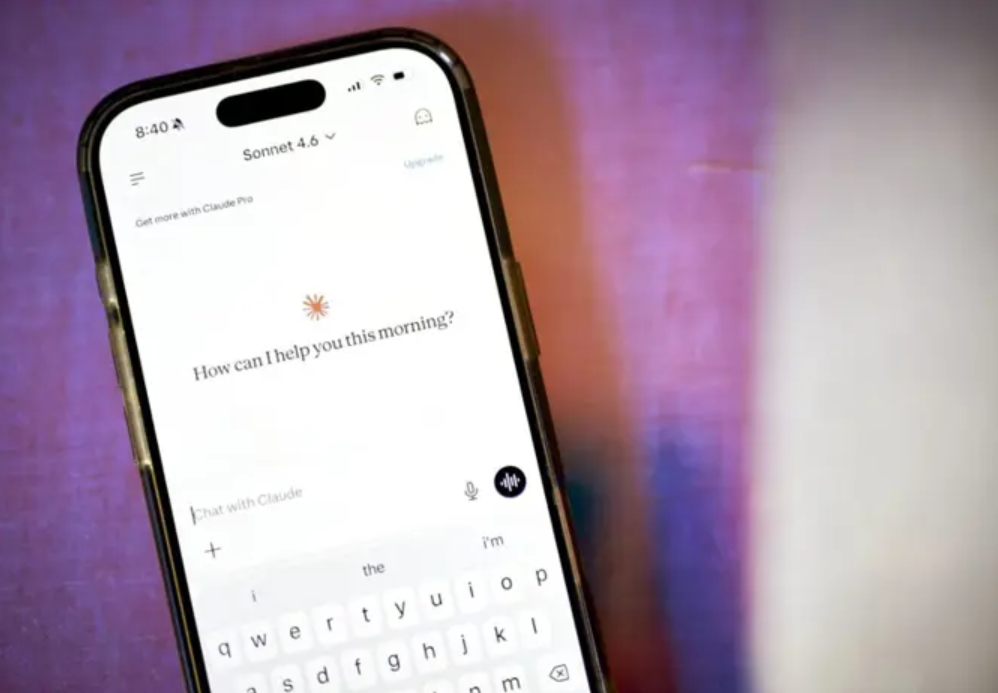

ومع الانتشار الواسع لهذه الأدوات، أصبحت خيارا شائعا للباحثين عن إرشادات صحية، حيث أعلنت OpenAI أن أكثر من 200 مليون مستخدم يطرحون أسئلة تتعلق بالصحة والعافية أسبوعيا عبر ChatGPT.

كما أطلقت الشركة أدوات صحية جديدة، بالتوازي مع خطوات مماثلة من شركات أخرى مثل أنثروبيك.

وحذر معدو الدراسة من أن غياب التوعية والرقابة قد يؤدي إلى تضخيم المعلومات المضللة، مؤكدين أن هذه الأنظمة قادرة على إنتاج إجابات تبدو موثوقة لكنها قد تكون غير دقيقة، ما يستدعي إعادة تقييم دورها في تقديم المعلومات الصحية للجمهور.