أصبح المحتوى المنتج بواسطة الذكاء الاصطناعي واقعيا إلى درجة يصعب معها التمييز بين الصورة أو الفيديو الحقيقي والمزيف على منصات التواصل الاجتماعي.

ومع هذا التدفق غير المسبوق للمحتوى الاصطناعي، برزت أدوات تعرف باسم “كاشفات الذكاء الاصطناعي” التي تدعي قدرتها على التفريق بين المحتوي الحقيقي والمولد رقميا عبر تتبع علامات خفية وأخطاء تركيبية وإشارات رقمية دقيقة.

لكن اختبارات موسعة أجرتها صحيفة “نيويورك تايمز” كشفت صورة أكثر تعقيدا، فبينما نجحت العديد من الأدوات في رصد بعض أشكال المحتوى الاصطناعي، فإن دقتها لم تكن كافية لمنح المستخدمين ثقة مطلقة بنتائجها.

وتشير النتائج إلى أن هذه الأدوات قد تدعم الشكوك، لكنها لا تصلح لإصدار أحكام نهائية، ما يفرض تحديات جديدة أمام المستخدمين ومدققي الحقائق في مواجهة سيل التزييف الذي اجتاح المنصات في الأشهر الأخيرة.

سباق تسلح رقمي

يرى خبراء أن كاشفات الذكاء الاصطناعي لن تتمكن يوما من بلوغ دقة 100%، خاصة مع التطور المتسارع في قدرات أدوات التوليد.

وأوضح مايك بيركنز، أستاذ في الجامعة البريطانية في فيتنام، أن أدوات كشف النصوص على وجه الخصوص أثبتت محدودية موثوقيتها، مشيرا إلى وجود “سباق تسلح” مستمر بين تقنيات التوليد وتقنيات الكشف.

وشملت اختبارات الصحيفة أكثر من 12 أداة ومنصة دردشة قادرة على تحليل الصور والفيديو والصوت والموسيقى، بإجمالي تجاوز ألف عملية فحص.

نتائج متفاوتة في كشف الصور

أظهرت الاختبارات أن العديد من الأدوات تمكنت من كشف الصور المزيفة البسيطة، خاصة تلك التي تتضمن وجوها بشرية وعناصر يمكن رصد اختلالاتها بسهولة، فعلى سبيل المثال، طلب من روبوت الدردشة ChatGPT التابع لشركة OpenAI إنشاء صورة لشخصين يضحكان.

ورغم واقعية النتيجة، احتوت الصورة على مؤشرات رقمية تدل على كونها مولدة بالذكاء الاصطناعي. ومع ذلك، لم يتمكن ChatGPT نفسه من التعرف على الصورة التي أنشأها قبل لحظات.

وتعتمد هذه الكاشفات على التدريب باستخدام قواعد بيانات ضخمة من المحتوى الاصطناعي، لتتعلم رصد “البصمات الرقمية” التي تتركها أدوات التوليد.

صعوبة أكبر مع المشاهد المعقدة

واجهت الأدوات صعوبات أكبر في تحليل الصور المعقدة التي لا تتضمن وجوها واضحة أو مؤشرات بصرية بارزة، مثل مشاهد طبيعية أو مناظر عامة.

ويرجح أن بعض الكاشفات دربت أساسا على التعرف إلى الوجوه لأغراض أمنية ومكافحة الاحتيال، ما يقلل فعاليتها في حالات أخرى.

مقاطع الفيديو التهديد القادم

يتزايد القلق من مقاطع الفيديو المولدة بالذكاء الاصطناعي، خاصة بعد إطلاق أداة Sora من OpenAI، والتي أدت إلى موجة من الفيديوهات المزيفة المنتشرة دون إشارات واضحة على زيفها.

عدد محدود فقط من الكاشفات قادر على تحليل الفيديو والصوت، وجاءت نتائجها متباينة. وتستثمر شركات متخصصة مبالغ كبيرة لتطوير أدوات قادرة على كشف التزييف في مكالمات الفيديو المباشرة أو التسجيلات الصوتية، في ظل مخاوف من استخدام نسخ صوتية مزيفة لانتحال شخصيات تنفيذية أو تنفيذ عمليات احتيال.

في بعض الحالات، نجحت الأدوات في كشف مقاطع فيديو مزيفة لانهيارات مبان أو مشاهد درامية، لكنها أخفقت في حالات أخرى، مثل مقطع واقعي المظهر أنتج باستخدام أداة Midjourney.

الصوت المزيف الأكثر إقناعا

تطورت تقنيات توليد الصوت بسرعة لافتة، وباتت تنتج تسجيلات تحاكي التنفس ونبرات الصوت البشرية بدقة، وتعد أدوات مثل ElevenLabs من أبرز الأمثلة، حيث تستخدم أصواتها في مقاطع رائجة وأحيانا في عمليات احتيال هاتفي.

استطاعت سبع من الأدوات المختبرة تحليل الصوت، وحققت منصات مثل Sensity وResemble.ai أفضل النتائج، إذ تمكنت من تحديد الأصوات المزيفة بدرجة ثقة عالية، حتى بعد تعديل المقاطع.

دقة أعلى في تأكيد المحتوى الحقيقي

أحد المخاطر المحتملة لكاشفات الذكاء الاصطناعي هو تصنيف محتوى حقيقي على أنه مزيف، ما قد يثير بلبلة في الأحداث الإخبارية العاجلة.

ومع ذلك، أظهرت الاختبارات أن الأدوات كانت أفضل في تأكيد صحة الصور والفيديوهات الحقيقية مقارنة بكشف المزيف منها.

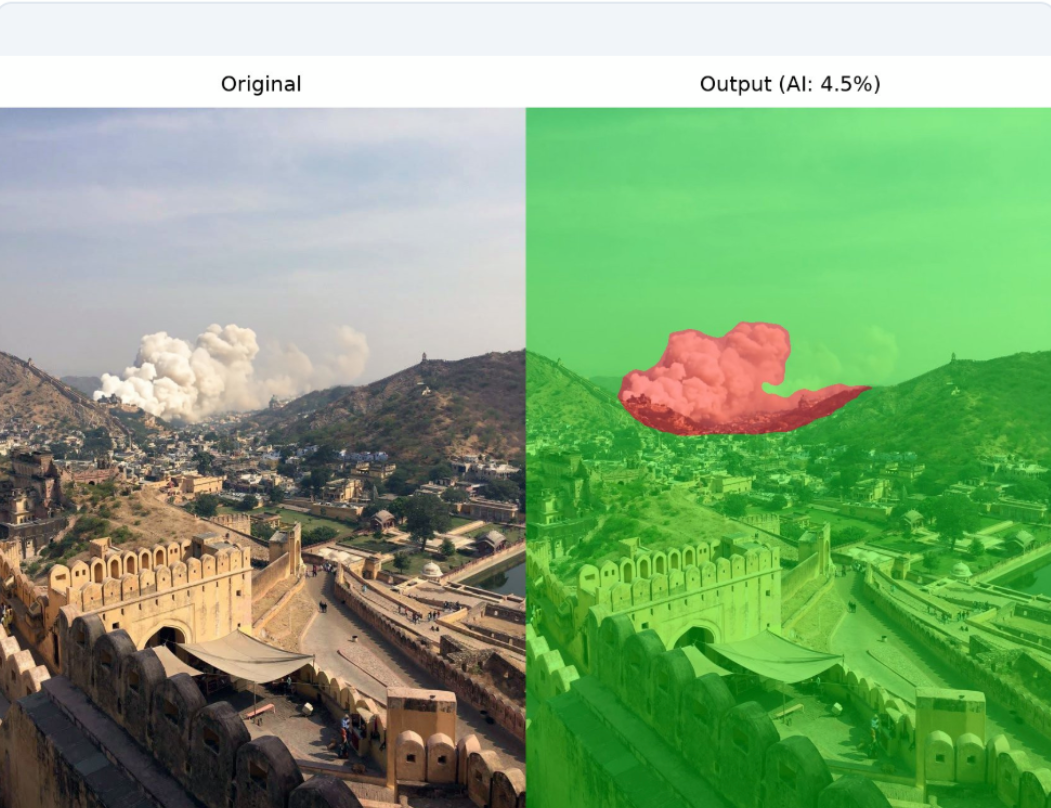

لكن التحدي الأكبر ظهر في الصور الحقيقية التي جرى تعديلها جزئيا باستخدام الذكاء الاصطناعي، ففي إحدى الحالات، أخفقت معظم الأدوات في اكتشاف إضافة دخان إلى صورة حقيقية، بينما استطاعت شركة Copyleaks، باستخدام نموذج تجريبي جديد، تحديد الجزء المعدل بدقة، مع الإشارة إلى أن بقية الصورة أصلية.

الخلاصة، تكشف النتائج أن أدوات كشف الذكاء الاصطناعي تمثل وسيلة مساعدة مهمة، لكنها ليست حكما نهائيا على صحة المحتوى، ومع استمرار تطور تقنيات التوليد، يبدو أن معركة "الحقيقي مقابل الاصطناعي" ستظل مفتوحة في المستقبل المنظور، ما يستدعي الجمع بين أدوات الكشف والتحقق الصحفي التقليدي لضمان دقة المعلومات.